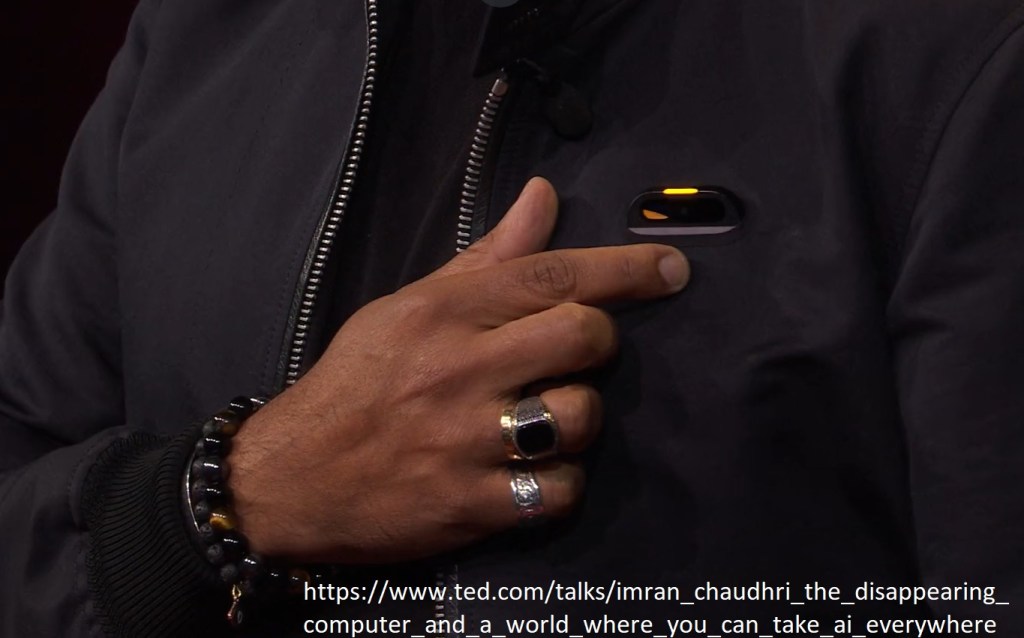

Imran Choudry, brytyjsko-amerykański przedsiębiorca, w przeszłości projektant firmy Apple, pokazał, jak jego zdaniem, w przyszości będziemy korzystać z przenośnej, sztucznej inteligencji. W świecie, gdzie dostęp do sztucznej inteligencji jest przenośny i zredukowany do małego klipa przypiętego do ubrania, komputery i ekrany częściowo przestają być potrzebne jako osobne urządzenia, które ze sobą nosimy.

Małe elektroniczne urządzenie wielkości małego zegarka bez bransolety, przypięte do ubrania, sterowane głosem i aktywowane dotknięciem pozwala na niekłopotliwe wykorzystywanie potencjału sztucznej inteligencji. Na przykład: tłumaczy nasze wypowiedzi na inne języki lub z innych języków na nasz. Sztuczna inteligencja poprzez sensory z klipu (m.in GPS, kamerę, mikrofon) jest gotowa na nasze głosowe polecenie próbować zrozumieć i opisać rzeczy, które np.: bierzemy do ręki, na które patrzymy, które słyszymy: co to za gatunek rośliny? co mieści się w tym budynku? co to za odgłos maszyny? czy mogę to zjeść? gdzie jestem? dokąd dojadę jadąc tędy? czy mam jakieś mejle służbowe do przeczytania? co w wiadomościach sms?

Jednocześnie ten klip wyświetla na dłoni sterowane światłem przyciski, których dotknięcie działa tak samo, jak dotknięcie klawiszy w telefonie (nie zawsze chcemy mówić w miejscu publicznym niektóre rzeczy – numery PIN itd). Takie rzeczy sztuczne inteligencje różnych producentów już teraz potrafią. Choudry wymyślił natomiast, że te możliwości można połączyć w jedno i dać jednostkom potencjał podłączenia do sieci neuronowych w internecie. Zaznacza również, że takie rozwiązania będą wymagać zabezpieczenia prywatności ludzi -> zabezpieczenia informacji na temat ludzi, zbieranych i przesyłanych przez taki klip.

Google ogłosiło wprowadzenie szeregu usług opartych na sztucznej inteligencji. Niestety niektóre nie działają jeszcze w Polsce. W naszym kraju te usługi zdaje się testowane są wyłącznie przez wąskie grono osób pracujących w firmach, które współpracują z Google. Do części z tych usług dostęp mam również ja, ale za mało korzystałem, żeby podjąć się recenzji. Mogę tylko powiedzieć, że jeśli Bard, czyli czat bot Google będzie miał lepszy poziom po polsku niż konkurencja, to solidnie namiesza.

Z ciekawych rzeczy: sztuczna inteligencja Google będzie w przyszłości działać tak, jak to opisał wyżej Imran Choudry, czyli rozmawiając z nią, pisząc do niej, w odpowiedzi będzie integrowała wszystkie dostępne jej źródła: Google Maps, fotografie, wyniki wyszukiwania stron, dostępne jej dokumenty (nasze prywatne, jeśli jej damy i publiczne). Różnica między wizją Choudry’ego i Google dotyczy urządzeń – oni nie są takimi minimalistami. Na konferencji pokazywali prototypy nowych telefonów (składany ekran) i opowiadali m.in o lekkich wersjach czat botów i funkcjach sztucznej inteligencji w systemie Android dla urządzeń przenośnych.

Narzędzia Google (Docs oraz inne) będą pracować używając algorytmów sztucznej inteligencji, upraszczając pracę: pisanie tekstów, mejli, tabel w Excelu itd. Niestety jeszcze nie po polsku. W tej chwili w 180 krajach i w trzech językach (angielski, japoński i koreański).

Drobne zmiany w usługach Google już teraz działające na terenie Polski to np.: za opłatą możemy mieć dostęp do bardziej rozbudowanych opcji edytowania zdjęć w usłudze Zdjęcia Google, czyli np retuszowanie – możemy usuwać ze zrobionych zdjęć obiekty (ludzie, przedmioty cokolwiek) a sztuczna inteligencja w miejsce usuniętego obiektu utworzy tło pasujące do zdjęcia tak, by nie było widać, że coś tu było. Mnie to niepotrzebne, ale jeśli ktoś z Państwa zawodowo robi dużo zdjęć telefonem i potrzebuje je szybko retuszować, to może być przydatne.

W przyszłości furorę w firmach, moim zdaniem, zrobią prywatne, firmowe czat boty nauczone firmowych dokumentów. W rozmowie z czat botem naszej (jako pracownicy) firmy będziemy mogli od razu np: sprawdzić zapisy umów, regulaminy firmowe, historię zamówień, zapytać o zalecenia i instrukcje itd. Wydaje mi się, że o ile ludzie często wstydzą się zapytać innych ludzi o radę, to nie będzie takiej bariery w relacji z czat botem. Ja w każdym razie używam tak sztucznej inteligencji, że proponuję jakieś teksty, plany, pomysły i proszę o feed back, o krytykę, o poradę co dodać. Czasem się przydaje.

Google chce być dostawcą takich prywatnych czat botów dla firm. Podobnie jak i Microsoft, które też zapowiedział dokładnie taką usługę.

Firmy będą na masową skalę mogły tworzyć aplikacje, które podłączone będą do sztucznej inteligencji Google’a, ale wytrenowanej w sposób potrzebny danej firmie. Na przykład: umiem sobie wyobrazić firmę, która robi aplikację do odrabiania zadań szkolnych. Następnie szkoli sztuczną inteligencję w odrabianiu tych zadań po polsku, buduje bazę zadań i rozwiązań i taką udostępnia taką płatną aplikację. Tak samo firma – operator turystyczny może stworzyć aplikację, która obsługuje klientelę sprzedając wycieczki, ale jednocześnie pełni rolę przewodnika/przewodniczki turystycznej na urlopie, przyjmuje skargi etc.

Prywatne osoby będą mogły podobnie używać czat botów, które sięgną do naszych zasobów (teksty, pdf’y itd.) na dysku Google i na tej podstawie będzie można porozmawiać z czatem. Ta usługa, w tej chwili działa tylko w USA i nazywa się Tailwind (wiatr od rufy).

Google zamierza też udostępnić usługi tworzenia muzyki słowami, obrazów (oraz prezentacji i grafik). Chcą jednocześnie wszystkie treści tworzone przez sztuczną inteligencję oznaczać tak, by obrazy nie mogły służyć dezinformacji i można było wykryć, czy dany obraz jest wykreowany.

Niektóre komentarze zwracają uwagę na to, że podczas konferencji Google padła zapowiedź ukończenia prac nad kolejnymi, jeszcze „mądrzejszymi” systemami sztucznej inteligencji, które de facto przekroczą ważny próg rozwoju. To będzie sztuczna inteligencja, która łączy wiedzę o bardzo różnych aspektach świata. Będziemy mieli więc do czynienia z coraz większymi sieciami neuronowymi, które praktycznie będą w stanie samodzielnie podejmować wiele działań, osiągać wiele celów, planować i realizować te plany. Google nie poinformowało, jak i co robi, żeby na ten rodzaj inteligencji nałożyć jakieś ograniczenia czy zabezpieczenia. Mówili natomiast chętnie o tym, że będą chronić prywatność ludzi oraz informacje, jakie zostawiamy w kontakcie z ich produktami.

Do streszczenia dwugodzinnego filmu z konferencji Google użyłem appki/wtyczki YoutubeDigest, która podczas oglądania filmiku na You Tube w okienku na tej samej stronie, po angielsku publikuje streszczenie filmu. Dzięki temu nie muszę wychodzić z oglądania, zmieniać kart, nie muszę otwierać kolejnych stron. Oglądając dostaję szybko streszczenie wypowiedzi z filmu. Bez instalowania wtyczki w swojej przeglądarce możecie to robić na piechotę: kopiując adres filmu z YouTube i wkleić go do Binga lub czata OpenAI i wydając polecenie: summarize (czyli po ang.: streść).