Czy maszyny i algorytmy mogą wykrywać emocje z wyrazu twarzy lub e-maili? Tak, ale pozostaje pytanie, na ile dokładnie. Technologia EAI (Emotion Artificial Intelligence) polega na wykrywaniu emocji i przekładaniu na mierzalne dane. Jeszcze w 2005 roku analizie emocji poddany został obraz „Mona Lisa” Leonardo da Vinciego. Sama nazwa obrazu „La Gioconda”, czyli „radosna”, pochodzi od nazwiska rodu. Potem emocje na obrazie maszynowo analizowane były jeszcze co najmniej raz. Maszynowa detekcja emocji wskazuje, że dominujące emocje obrazu to szczęście oraz/albo neutralna emocja (neutral emotion). Ludzie podobnie odczytują ten obraz, ale od maszyn różnimy się tym, że nie wszyscy równie dobrze odczytujemy emocje innych ludzi a zagadkowość wyrazu twarzy Mony Lisy fascynuje.

Emotion Artificial Intelligence to technologia, która np. odróżnia szczęście od gniewu, pomagając firmom lepiej sprzedawać swoje produkty: zabawki, filmy, żywność itd. Teoretycznie aplikacje zakupowe mogłyby dostosowywać treści w oparciu o wykryte emocje użytkowników, zwiększając sprzedaż. EAI mogłoby być używane w inteligentnych zabawkach, robotyce, empatycznych czabotach a także w analizie produktywności pracowników i analizie zachowań klienteli w sklepach.

Z jednej strony w ostatnich latach przybywało badań z tego obszaru. Z drugiej jednak, rynek chyba jeszcze nie ufa tym nowinkom. Z tej listy 15 „uznanych na świecie firm emocjonalnej sztucznej inteligencji”(2021), po dwóch latach tylko dwie firmy prowadzą działalność dokładnie taką, jaką zapowiadały w 2021 roku. Pozostałe albo upadły, albo się lekko przebranżowiły (pivotowały – jak mówi branża startapowa).

Oprócz marketing i reklamy są też inne możliwe zastosowania tej technologii:

- opieka zdrowotna, gdzie kontakt z osobami o ograniczonych możliwościach komunikacji jest ważny

- edukacja: ocena skuteczności procesu edukacyjnego i zarządzanie tym procesem

- bezpieczeństwo: wykrywanie emocji i monitoring

- transport: wykrywanie emocji i zmęczenia wśród personelu kierująceg oraz klienteli (transport automatyczny).

Praca naukowa Emotion recognition and artificial intelligence: A systematic review

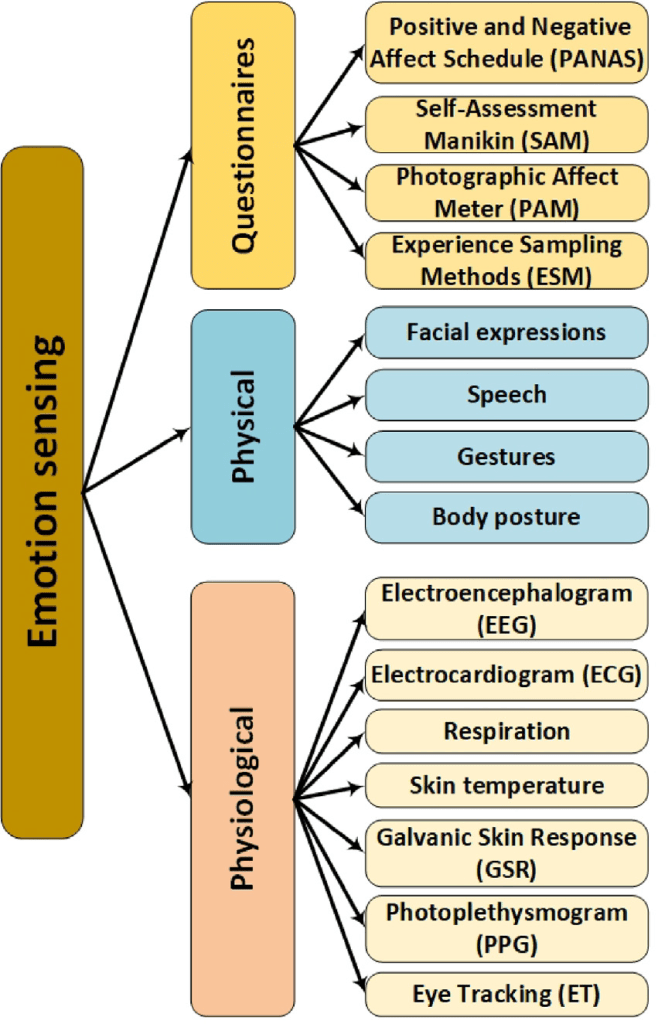

(2014–2023) and research recommendations (Khare et al.) zauważa, że najbardziej skuteczna jest ocena emocji na podstawie więcej niż jednego objawu. Samo tętno, sam wyraz twarzy czy tembr głosu mogą być niewystarczające. Podejście wielotorowe daje lepsze rezultaty. Na podstawie ok 140 badań powstał ten wykres technik badania emocji, gdzie na górze w kolorach jasnych są przeważnie mniej skuteczne metody kwestionariuszowe (pytania i odpowiedzi) – niżej pomiary fizyczne i fizjologiczne. W tym schemacie my jesteśmy myszami laboratoryjnymi a to są możliwe badania.

(2014–2023) and research recommendations – S.K Khare et al.

Interesujące, że w niektórych przypadkach badania (fizjologiczne) informują o ponad 90% skuteczności pomiaru! Choć zauważyłem również, że warto wczytać się detale, bo często nie chodzi o pomiar wielu emocji, ale niektórych. Na przykład, w badaniu o najwyższej, raportowanej skuteczności pomiaru emocji w głosie (90,08%) badano próbkę głosu na obecność oznak szczęścia, smutku, gniewu i strachu. Przeważnie też eksperyment przeprowadzany był na nieruchomych zdjęciach twarzy (klatki z filmu) a nie był np. obserwacją żywych ludzi.

Firma Behavioral Signals – Emotion Cognitive AI informuje, że mają szereg patentów w tej dziedzinie oraz że ich system wykrywania emocji w głosie pozwala odgadnąć, czy dana osoba skłonna jest wziąć pożyczkę, kupić coś, spłacić dług, odejść z pracy czy że jest rozgniewana. Skuteczność, rzekomo od 68% do 85%. Podobne usługi oferuje Intelligent Voice, która m.in obiecuje, że ich technologia pozwoli rozpoznać próbę oszustwa przez telefon, gdyż sztuczna inteligencja jest w stanie rozpoznać kłamstwo i skrywane emocje.

Zastanawiam się tylko, co w sytuacji, gdy gangi przestępcze również zaczną posługiwać się tego rodzaju technologiami, ale w odwrotnym celu? Będą używać technologii, żeby fejkować emocje i oszukać mechanizmy weryfikacji?

Firma Affectiva, będąca pionierką rynku badań emocji, reklamuje swoje oprogramowanie i technologię sztucznej inteligencji, jako zdolne wykrywać nawet „zniuansowane emocje”, „złożone stany poznawcze” a także „zachowania, czynności i przedmioty używane”. Jednak w broszurce reklamowej (którą nazywają e-bookiem), dają przykłady wykrywania wyłącznie prostych emocji jako metody oceny skuteczności reklam wideo (tv/internet). Jako najskuteczniejszą metodę oceny reklam podają mix obserwacji wyrazu twarzy z kwestionariuszem, gdzie osoba obserwowana odpowiada na pytania. Co bardzo ciekawe, z ich materiałów wynika, że niektóre reklamy (niektóre produkty?) wywołują emocje lepiej wykrywane w kwestionariuszu niż w obserwacji twarzy – podany przykład amerykańskiej reklamy gumy do żucia. Skuteczność tej reklamy gumy do życia nie przewidziało badanie mikroekspresji (twarz), ale kwestionariusz już tak.

Morphcast natomiast specjalizuje się, podobnie jak Affectiva, w analizowaniu skuteczności filmów i reklam. Wykrywa emocje na podstawie obrazu i jako przykłady zastosowań podaje współpracę z firmami produkującymi programy telewizyjne, filmy oraz reklamy.

Szwajcarska firma NVISO informuje o multimodalnym modelu analizy emocji i przewidywania decyzji oraz zachowań. Nieco humorystyczne, że na ich stronie zostałem przez system CAPTCHA zostałem oceniony jako robot. NVISO proponuje technologię, która łączy obserwację twarzy, nachylenia głowy, spojrzenia z pomiarem pracy serca, zachowań, mowy ciała i gestów. To wszystko poprzez obraz wideo i zwykła kamerka wystarczy(!).

Firma oferuje możliwość podłączenia kamer do ich serwerów i banku wiedzy (API), gdzie ich sztuczna inteligencja analizuje obraz z naszej kamery oraz przekazuje analizę. Działają w przemyśle rozrywkowym (gry), opiece zdrowotnej i robotyce konsumenckiej oraz w przemyśle motoryzacyjnym – przykład poniżej.

Chińska firma z Hong-Kongu 4 Little Trees wdraża technologię wykrywania emocji u dzieci i młodzieży szkolnej. Maszynowo analizowany jest obraz twarzy a ruchy odpowiednich mięśni twarzy interpretowane są przez algorytmy w celu przypisania emocji. Firma wystartowała w 2017 roku. Jej produkty zostały zauważone podczas pandemii, w latach 2020-2021, gdy szkoły przez dłuższy czas nie działały i szczególnie istotny stał się problem oceny postępów u osób uczących się zdalnie. Kadra nauczycielska jest np. w stanie ocenić, czy praca domowa albo inne zadania zostały wykonane z niechęcią, czy nie. Takie informacje w kontakcie zdalnym mają pomóc w jak najlepszym poprowadzeniu zajęć.

Podobnych informacji na podstawie analizy głosu dostarcza Real-Time AI Coaching & Guidance for Contact Centers | Cogito (cogitocorp.com). To jest technologia, która wykrywa emocje w głosie i podpowiada personelowi z Call Center jak prowadzić rozmowę z osobą w danym stanie emocjonalnym. Chwalą się, że ta technologia m.in jest używana na infoliniach, gdzie dzwonią weterani wojenni.

W ramach projektów Narodowego Centrum Badań i Rozwoju IDEAS prowadzone będą badania nad możliwością użycia sztucznej inteligencji do wykrywania niektórych problemów emocjonalnych i psychicznych. Analizowany byłby tekst oraz zawartość mediów społecznych. Tego typu narzędzia, za zgodą osoby badanej, mogą pomóc w skutecznej diagnozie.

Maszynowa analiza emocji w tekście jest też częścią technologii czata GPT. Możemy dowolny tekst poddać analizie tzw. sentymentu i dostać ocenę emocji wyrażanych w tekście – sporo firm oferuje tą usługę w pakiecie z innymi usługami przydatnymi w marketingu i reklamie.

Eleanor Roosevelt, autorka wielu złotych myśli powiedziała kiedyś, że „Bez Twojej zgody nikt nie sprawi, że poczujesz się gorszą osobą”. Czyli sami decydujemy, czy uważamy się za gorszych od innych. W przyszłości to zdanie może powinno brzmieć inaczej: „Bez Twojej zgody nikt nie sprawi, że poczujesz się gorszą osobą, ale wtedy po prostu sprzedadzą Ci coś innego„.

Na podstawie m.in:

https://www.businessinsider.com/ai-surveillance-detects-emotion-at-work-gets-you-fired-2023-11

In Hong Kong, this AI reads children’s emotions as they learn | CNN Business